कृत्रिम बुद्धिमत्ता हे नेहमीपेक्षा सोपे करते सामग्री निर्मिती आणि घोटाळेबाज याचा फायदा घेतात. सिक्युरिटी फर्म McAfee कडून गुरुवारी प्रसिद्ध झालेल्या अहवालात असे आढळून आले आहे की बऱ्याच अमेरिकन लोकांनी (72%) सेलिब्रिटी किंवा प्रभावशाली व्यक्तींकडून बनावट समर्थन पाहिले आहेत. ऑनलाइन घोटाळ्यांमध्ये ज्या सेलिब्रिटींची नावे, प्रतिमा आणि समानतेचा गैरफायदा घेतला जातो, त्यापैकी टेलर स्विफ्टची नावे सर्वात जास्त वापरली जातात.

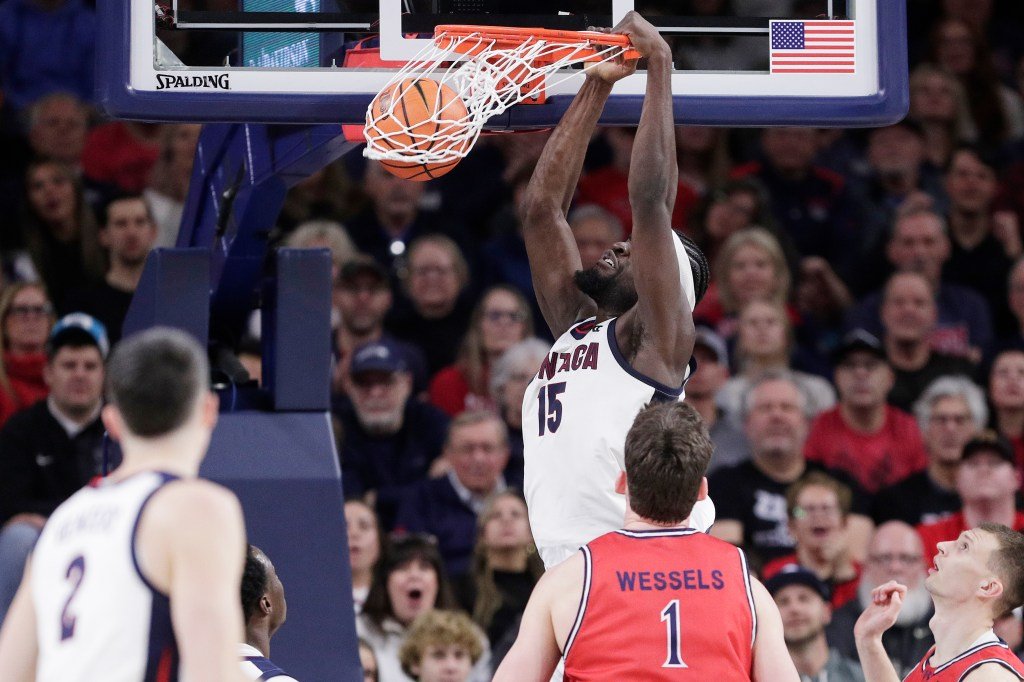

स्विफ्ट नंतर, इतर सेलिब्रिटी ज्यांचे फोटो ऑनलाइन घोटाळ्यांमध्ये जास्त वापरले जातात ते आहेत स्कारलेट जोहानसन, जेना ऑर्टेगा आणि सिडनी स्वीनी. टॉप टेनमधील बहुतेक पॉप कल्चर आयकॉन किंवा संगीतकार आहेत, ज्यात सॅब्रिना कारपेंटर, किम कार्दशियन आणि झेंडया यांचा समावेश आहे. अमेरिकेचे प्रतिनिधी अलेक्झांड्रिया ओकासिओ-कॉर्टेझ या यादीतील एकमेव महिला राजकारणी आहेत. विशेष म्हणजे, फक्त दोन पुरुष आहेत: टॉम क्रूझ आणि लेब्रॉन जेम्स.

आमची कोणतीही निष्पक्ष तांत्रिक सामग्री आणि प्रयोगशाळेची पुनरावलोकने चुकवू नका. CNET जोडा Google चा पसंतीचा स्रोत म्हणून.

हा अभ्यास उत्पादन-आधारित, ग्राहकाभिमुख ऑनलाइन घोटाळ्यांवर केंद्रित आहे, जसे की बनावट क्रिप्टोकरन्सी AOC-मंजूर असल्याचा दावा करतात. हे तयार केलेल्या सर्व डीपफेकच्या पातळीचे मोजमाप करत नाही, म्हणूनच अध्यक्ष डोनाल्ड ट्रम्प सारख्या इतर उच्च-प्रोफाइल व्यक्ती शीर्ष 10 मध्ये नाहीत. या प्रकारचे ऑनलाइन स्कॅमर लोकांना त्यांच्या सामग्रीशी संवाद साधण्यावर अवलंबून असते, मग ते बनावट लिंकवर क्लिक करून, फसव्या भेटवस्तूंसाठी अर्ज करून किंवा बनावट उत्पादने खरेदी करून असो. त्यामुळे, दुर्दैवाने, आमचे लक्ष वेधण्यासाठी ते स्विफ्ट सारख्या मोठ्या नावांवर अवलंबून आहेत याचा अर्थ होतो. उदाहरणार्थ, जेव्हा स्विफ्टने ट्रॅव्हिस केल्सेशी तिच्या प्रतिबद्धतेची घोषणा केली, तेव्हा स्कॅमर्सनी केल्सीच्या प्रस्तावावर आधारित बनावट मालासाठी जाहिराती तयार केल्या. ख्यातनाम व्यक्ती आणि प्रभावशाली व्यक्तींचे अशा प्रकारे दीर्घकाळ शोषण केले जात आहे, परंतु AI वाईट कलाकारांना दुर्दैवी प्रोत्साहन देत आहे.

जनरेटिव्ह AI टूल्स जसे की इमेज, व्हिडिओ आणि ऑडिओ जनरेटर वाईट कलाकारांना नवीन मार्ग देतात. ते बनावट समर्थन तयार करण्यासाठी, भेट देण्यासाठी किंवा बनावट उत्पादनांचा प्रचार करण्यासाठी सेलिब्रिटीच्या प्रतिमेचे क्लोन करू शकतात. स्कॅमरला पुरेशी खात्री पटणारी सोशल मीडिया पोस्ट तयार करणे आवश्यक आहे. McAfee ने अहवाल दिला की 39% लोकांनी या खोट्या समर्थनांवर क्लिक केले आणि त्यापैकी 10% लोकांनी त्यांची वैयक्तिक माहिती धोक्यात आणली, सरासरी शेकडो डॉलर्स गमावले ($525).

हे AI मॉडेल्स तयार करणाऱ्या AI कंपन्यांकडे स्कॅमर किंवा कोणीही सेलिब्रिटींसाठी त्यांच्या संमतीशिवाय AI सामग्री तयार करण्यापासून रोखण्याचा प्रयत्न करण्यासाठी सिस्टम आहेत. परंतु या प्रणाली कशा परिपूर्ण नाहीत आणि त्यावर मात केली जाऊ शकते हे आपण यापूर्वी अनेकदा पाहिले आहे. Sora लाँच झाल्यानंतर पहिल्या काही आठवड्यांमध्ये, नागरी हक्क नेते मार्टिन ल्यूथर किंग ज्युनियर यांच्या इस्टेटला OpenAI कडे संपर्क साधावा लागला कारण ते प्लॅटफॉर्मवर King’s AI द्वारे वापरल्या जाणाऱ्या अयोग्य आणि वर्णद्वेषी व्हिडिओंबद्दल चिंतित होते. ओपनएआयने असे करण्याची योजना आखली आहे या विषयावर अभिनेते आणि सेलिब्रिटींसोबत काम करत आहेकेवळ साध्या तांत्रिक किंवा धोरणात्मक सुधारणांद्वारे सोडवता येणारी ही समस्या नाही.

AI वापरून सेलिब्रिटी घोटाळा कसा शोधायचा

AI-व्युत्पन्न सामग्री ओळखणे कठीण आहे, परंतु अशा काही गोष्टी आहेत ज्यांचे तुम्ही निरीक्षण करू शकता. येथे काही आहेत.

- व्हिडिओ किंवा फोटो बारकाईने तपासा. अशा काही गोष्टी आहेत ज्या गायब होतात आणि इतर पुन्हा दिसतात? ते भौतिकशास्त्राच्या नियमांचे पालन करते का? लोकांमध्ये चमकदार, विचित्रपणे प्लास्टिकसारखे स्वरूप आहे का? ही सर्व कृत्रिम बुद्धिमत्तेची लक्षणे आहेत.

- वॉटरमार्क तपासा. अनेक AI जनरेटर आपोआप स्पष्ट (किंवा इनलाइन) वॉटरमार्क जोडतील, ते AI आहे हे दर्शविण्यासाठी.

- Instagram, TikTok किंवा YouTube ने आधीच AI-व्युत्पन्न म्हणून पोस्ट लेबल केलेली नाही याची खात्री करा. कोणत्याही प्रकारची AI लेबले हे स्पष्ट लक्षण आहे की तुम्ही जे पाहत आहात ते खरे नाही.

एआयच्या युगातही, घोटाळे शोधण्याचा सल्ला प्री-एआय काळापेक्षा फारसा वेगळा नाही. घोटाळेबाज कृत्रिम बुद्धिमत्ता वापरत असले तरी ते अजूनही त्याच पद्धती वापरतात.

“लाल झेंडे बदललेले नाहीत: तातडी, भावनिक दबाव, आणि वैयक्तिक माहिती किंवा पेमेंटसाठी विनंत्या हे अजूनही सर्वात मोठे देणे आहेत,” McAfee चे धोका संशोधन प्रमुख अभिषेक कर्णिक यांनी ईमेलमध्ये सांगितले.

येथे काही आहेत घोटाळा लाल झेंडे पाहण्यासाठी.

- क्लिक करण्यापूर्वी विचार करा. कर्णिक म्हणाले की, घोटाळे तातडीची भावना किंवा भावनिक प्रतिक्रिया निर्माण करण्यासाठी डिझाइन केलेले आहेत.

- स्त्रोत तपासा. लिंक चुकीची आहे की चुकीची आहे? अधिकृत सेलिब्रिटी खात्याने उत्पादनाबद्दल पोस्ट केले का? खाते सत्यापित आहे का? हे सर्व तुम्हाला वास्तविक घोटाळा डीकोड करण्यात मदत करू शकतात.

- संशयास्पद व्हा क्रिप्टोकरन्सी, Venmo सारख्या पेमेंट ॲप्स किंवा इतर अनधिकृत स्रोतांद्वारे पेमेंटची विनंती करणाऱ्या साइटवरून

कर्णिक म्हणाले की, घोटाळेबाज तुमचा विश्वास उडवण्याचा प्रयत्न करतील. तुमची वैयक्तिक माहिती सामायिक करताना सावधगिरी बाळगणे आणि सावधगिरी बाळगणे तुम्हाला घोटाळ्यात पडणे टाळण्यात मदत करू शकते. एखादी गोष्ट स्विफ्टने मंजूर केली आहे किंवा वापरली आहे असे म्हटल्याने याचा अर्थ असा नाही की ते प्रत्यक्षात आहे.

अधिकसाठी, पहा बँक फसवणूक कशी शोधायची आणि फिशिंग ईमेल यापुढे का स्पष्ट दिसत नाहीत?. (प्रकटीकरण: Ziff Davis, CNET ची मूळ कंपनी, ने एप्रिलमध्ये OpenAI विरुद्ध खटला दाखल केला, आरोप केला की त्यांनी AI सिस्टीमचे प्रशिक्षण आणि संचालन करताना Ziff Davis च्या कॉपीराइटचे उल्लंघन केले आहे.)